要点:

- 根据 Semafor 的一份报告,据报道,GPT-4 比 GPT-3 大六倍左右,具有 1 万亿个参数,该公司之前曾在 Bing 中泄露过 GPT-4。

- 除了参数数量外,数据质量和数据训练量对人工智能系统的质量也很关键。 OpenAI 没有给出关于这些因素的官方数据。

据媒体报道,GPT-4 据报道比 GPT-3 大六倍。美国网站 Semafor 援引八名知情人士的话说,OpenAI 的新 GPT-4 语言模型有 1 万亿个参数。 它的前身 GPT-3 有 1750 亿个参数。

Semafor 此前曾在官宣前分别于 1 月和 2 月透露了微软对 OpenAI 的 100 亿美元投资以及将 GPT-4 集成到 Bing 中。

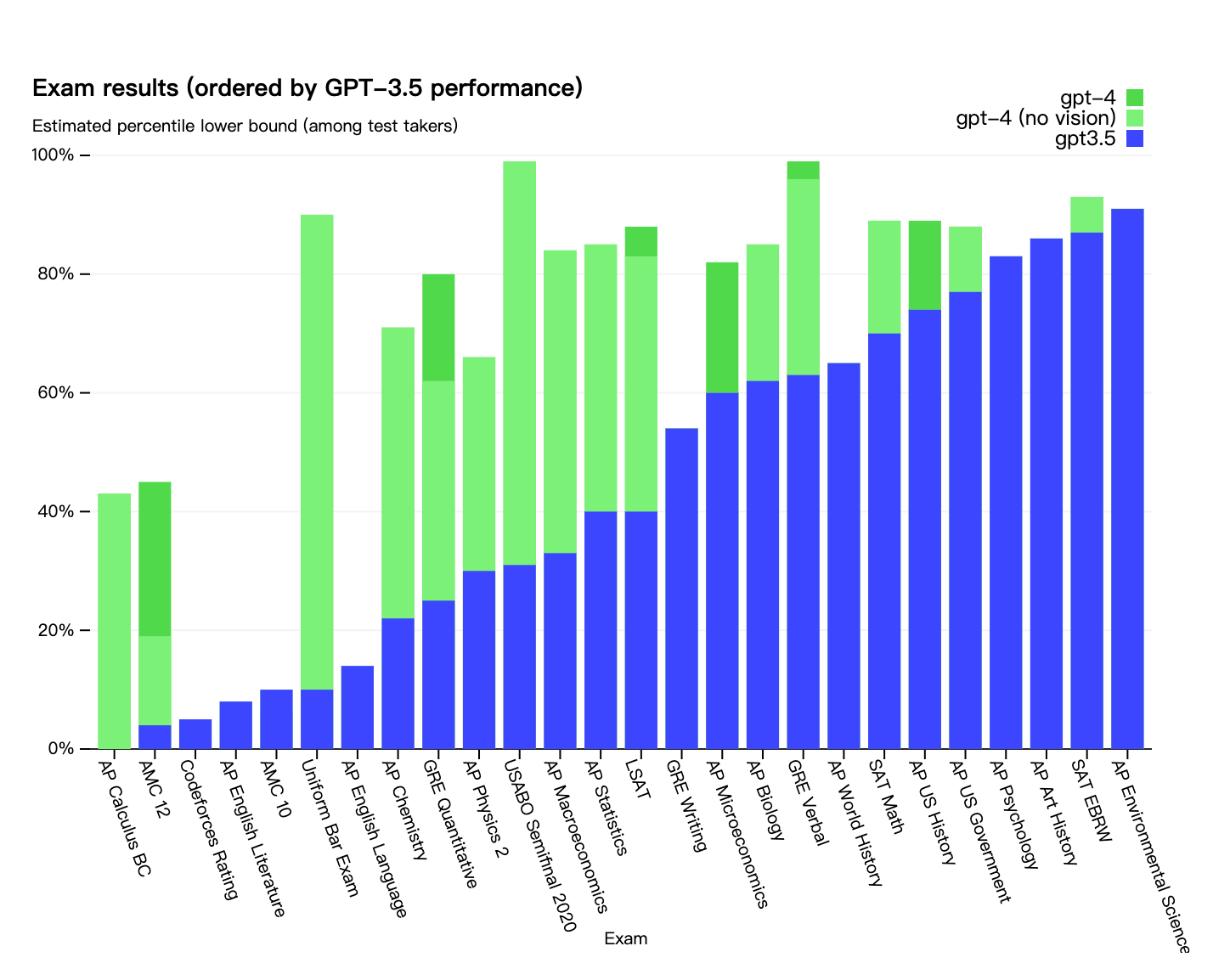

语言模型中的参数数量是其识别数据中的复杂模式和关系以及开发新的紧急能力的指标。 参数通过权重决定输入和输出的关系。 权重是在训练过程中学习的。

图片由人工智能Midjourney生成

除了模型大小,数据质量和训练数据量对 AI 性能也至关重要。 例如,Deepmind Chinchilla 已经表明,一个只有 700 亿个参数但经过更广泛的数据训练的 AI 系统可以胜过 GPT-3 等更大的系统。

在宣布 GPT-4 时,OpenAI 没有透露参数数量和使用的训练数据,这遭到了批评。 OpenAI 将“竞争环境”列为保密的原因。

参考资料:

https://the-decoder.com/gpt-4-has-a-trillion-parameters/

本网站所有内容来源注明为“williamhill asia 医学”或“MedSci原创”的文字、图片和音视频资料,版权均属于williamhill asia 医学所有。非经授权,任何媒体、网站或个人不得转载,授权转载时须注明来源为“williamhill asia 医学”。其它来源的文章系转载文章,或“williamhill asia 号”自媒体发布的文章,仅系出于传递更多信息之目的,本站仅负责审核内容合规,其内容不代表本站立场,本站不负责内容的准确性和版权。如果存在侵权、或不希望被转载的媒体或个人可与williamhill asia 联系,williamhill asia 将立即进行删除处理。

在此留言

#GPT-4#

61